本ページはプロモーション(PR)が含まれています

更新日: 2024/10/07

スパコン「富岳」で学習したFugaku LLMをHugging Faceからダウンロードして使う方法

目次

はるか

Fugaku-LLMを知ってる?日本のスーパーコンピュータ「富岳」で学習した大規模言語モデル。

ふゅか

知ってるわ!日本語のLLMだね♪

Fugaku LLMとは?

Fugaku-LLMは、日本のスーパーコンピュータ「富岳」を活用した大規模言語モデルです。このモデルは、特に日本語の自然言語処理において高い性能を発揮することが期待されています。Fugaku-LLMは東京工業大学、東北大学、富士通、理化学研究所、名古屋大学、サイバーエージェント、Kotoba Technologiesの共同研究チームによって開発された。

Hugging Faceの設定

Hugging Faceの認証トークン取得

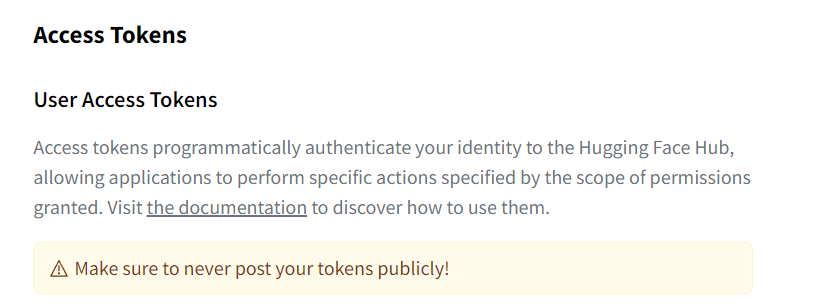

Fugaku-LLMを利用するためにはトークンが必要です。Hugging Faceのトークンを取得するために、以下の手順に従ってください。

- Hugging Faceのウェブサイトにアクセスし、アカウントを作成またはログインします。

- プロフィールアイコンをクリックし、

Settingsを選択します。 Access Tokensセクションに移動し、新しいトークンを作成します。トークンには名前とwriteの権限を設定してください

はるか

トークンは流出しないように。

モデルのアクセス権限を確認

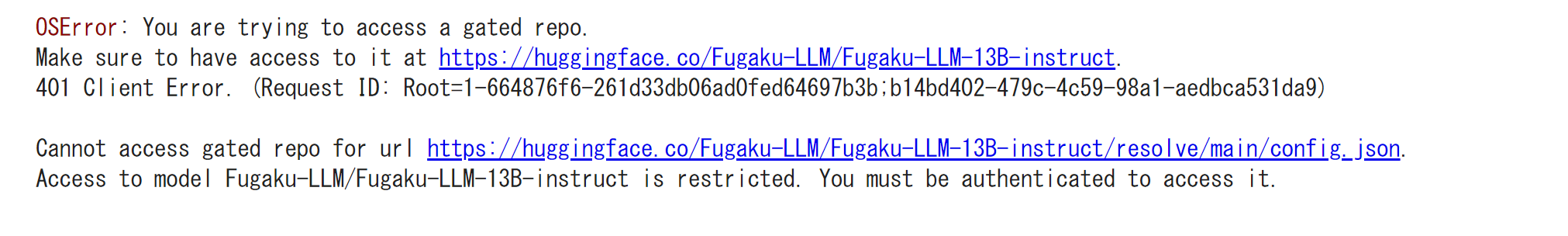

Fugaku-LLMのモデルにアクセスするために、アクセス権限が必要です。Hugging FaceのFugaku-LLMのリポジトリでアクセス権限を取得してください。

ふゅか

アカウントでログインしている必要があります!

モデルのアクセス権限がないと、「Access to model Fugaku-LLM/Fugaku-LLM-13B-instruct is restricted. You must be authenticated to access it.」となります。

はるか

Fugaku-LLMのリポジトリでアクセス権限を取得する必要がある。

ふゅか

そうね、アクセス権限がないとモデルが使えないから、忘れずにリクエストしないとね♪

Fugaku LLMを動かす

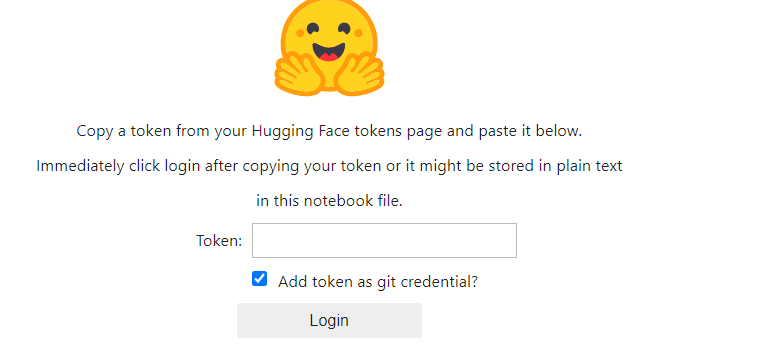

Tokenの設定

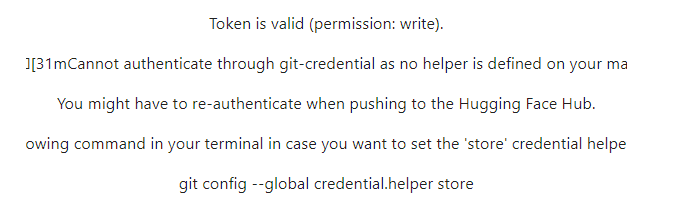

Tokenに先ほど設定したトークンを入力して使用します。

from huggingface_hub import login

# Hugging Faceにログイン

login()Fugaku LLMを使用した文章生成

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer

# モデルのパスを設定

model_path = "Fugaku-LLM/Fugaku-LLM-13B-instruct"

# トークナイザーのロード

tokenizer = AutoTokenizer.from_pretrained(model_path)

# モデルのロード

model = AutoModelForCausalLM.from_pretrained(model_path, torch_dtype=torch.bfloat16)

model.eval()

# システムの例と指示の例を設定

system_example = "以下は、タスクを説明する指示です。要求を適切に満たす応答を書きなさい。"

instruction_example = "あなたの今日の晩御飯の気分を教えてください。"

# プロンプトを作成

prompt = f"{system_example}\n\n### 指示:\n{instruction_example}\n\n### 応答:\n"

# 入力IDをトークナイズ

input_ids = tokenizer.encode(prompt,

add_special_tokens=False,

return_tensors="pt")

# テキストを生成

tokens = model.generate(

input_ids.to(device=model.device),

max_new_tokens=128,

do_sample=True,

temperature=0.1,

top_p=1.0,

repetition_penalty=1.0,

top_k=0

)

# 生成されたトークンをデコード

out = tokenizer.decode(tokens[0], skip_special_tokens=True)

print(out)ふゅか

どうやら、今日の晩御飯の気分はタイカレーのようだね!

Transformers・大規模言語モデルに関連する書籍

ブックオフ2号館 ヤフーショッピング店

bookfanプレミアム

大規模言語モデル入門II-生成型LLMの実装と評価 / 山田育矢 〔本〕

posted with カエレバ

HMV&BOOKS online Yahoo!店

関連記事

【Transformers】エラーValueError: Asking to pad but the tokenizer does not have a padding token. Please select a token to use as `pad_token`・・・・解決方法

python

LLM

text-generation

transformers

自然言語処理

数学に特化した言語モデル!NuminaMath-7B-TIRグラフの表示や数学の問題を解く

python

LLM

text-generation

transformers

自然言語処理

matplotlib

meta-llama/Meta-Llama-3-8Bの使い方!導入から活用までの徹底解説

python

LLM

text-generation

transformers

自然言語処理

【Transformers】SwallowをHugging Faceで使う方法

python

LLM

text-generation

transformers

自然言語処理

大規模言語モデルにおけるpadding_token[PAD]の意味について

![大規模言語モデルにおけるpadding_token[PAD]の意味について](/articles/machine-learning-and-deep-learning/llm-padtoken/thumbnail.webp)

Webアプリケーションフレームワーク

LLM

text-generation

transformers

自然言語処理

「Gemma-2-9B」の力を試す!アニメと数学についてGoogleのAIに質問してみた

python

LLM

text-generation

自然言語処理