本ページはプロモーション(PR)が含まれています

更新日: 2024/09/30

ValueError: The checkpoint you are trying to load has model type `gemma2` but Transformers does not recognize this architecture.の解決方法!gemma2の読み込み

はるか

gemma2が読み込めない…。

ふゅか

うーん、とりあえずエラーログを見てみよう!

エラーの詳細

ValueError: The checkpoint you are trying to load has model type 'gemma2' but Transformers does not recognize this architecture.

This could be because of an issue with the checkpoint, or because your version of Transformers is out of date.訳

あなたが読み込もうとしたgemma2タイプのモデルタイプを持っているが、Transformersライブラリがそのアーキテクチャを認識しないことを示しています。この問題の原因としては、チェックポイント自体の問題、またはTransformersライブラリのバージョンが古い可能性があります。

ふゅか

このエラー、チェックポイントかTransformersのバージョンに問題があるみたいね。

はるか

なるほど、Transformersをアップデートしよう。

エラー解決のためのTransformersのアップデート

解決方法

このエラーは、gemma2アーキテクチャをサポートしていない古いバージョンのTransformersを使用していることが原因です。以下のコマンドを実行して、Transformersのバージョンをアップデートしてください。

pip install -U transformersはるか

pipコマンドで簡単にアップデートできる。

バージョンの確認とアップデート

元のバージョンは4.41.2でしたが、アップデート後は4.42.4に変更されました。このバージョンで、gemma2アーキテクチャが認識されるようになります。

動作確認

ふゅか

ちゃんと、gemma2が動くか確認してみよう!

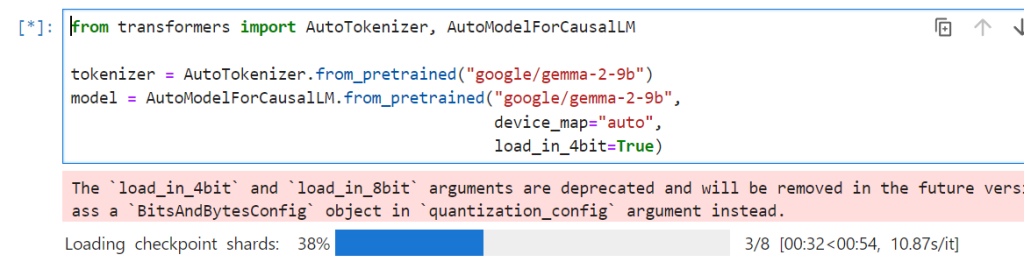

from transformers import AutoTokenizer, AutoModelForCausalLM

tokenizer = AutoTokenizer.from_pretrained("google/gemma-2-9b")

model = AutoModelForCausalLM.from_pretrained("google/gemma-2-9b",

device_map="auto",

load_in_4bit=True)まとめ

Transformersのバージョンを最新に保つことで、新しいアーキテクチャのサポートやバグ修正が反映されます。定期的にアップデートを行い、エラーの発生を防ぎましょう。

Transformers・大規模言語モデルに関連する書籍

ブックオフ2号館 ヤフーショッピング店

bookfanプレミアム

大規模言語モデル入門II-生成型LLMの実装と評価 / 山田育矢 〔本〕

posted with カエレバ

HMV&BOOKS online Yahoo!店

関連記事

長期記憶を持つ?言語モデルのアーキテクチャ「Titans」の革新性をわかりやすく解説

LLM

transformers

自然言語処理

【Transformers】エラーValueError: Asking to pad but the tokenizer does not have a padding token. Please select a token to use as `pad_token`・・・・解決方法

python

LLM

text-generation

transformers

自然言語処理

大規模言語モデルにおけるpadding_token[PAD]の意味について

![大規模言語モデルにおけるpadding_token[PAD]の意味について](/articles/machine-learning-and-deep-learning/llm-padtoken/thumbnail.webp)

Webアプリケーションフレームワーク

LLM

text-generation

transformers

自然言語処理

数学に特化した言語モデル!NuminaMath-7B-TIRグラフの表示や数学の問題を解く

python

LLM

text-generation

transformers

自然言語処理

matplotlib

meta-llama/Meta-Llama-3-8Bの使い方!導入から活用までの徹底解説

python

LLM

text-generation

transformers

自然言語処理

deepsetのbert-large-uncased-whole-word-masking-squad2の使い方!Question Answering

python

LLM

transformers

自然言語処理

Question Answering