機械学習・ディープラーニング

-

勾配(gradient)について!意味とディープラーニングへの応用について

勾配とは 勾配の特徴 勾配の計算の具体例 2変数関数 \( f(x,y) = x^2 + y \) の勾配は、関数の各変数に関する偏微分を計算することで求められます。勾配ベクトルは次のように定義されま …

-

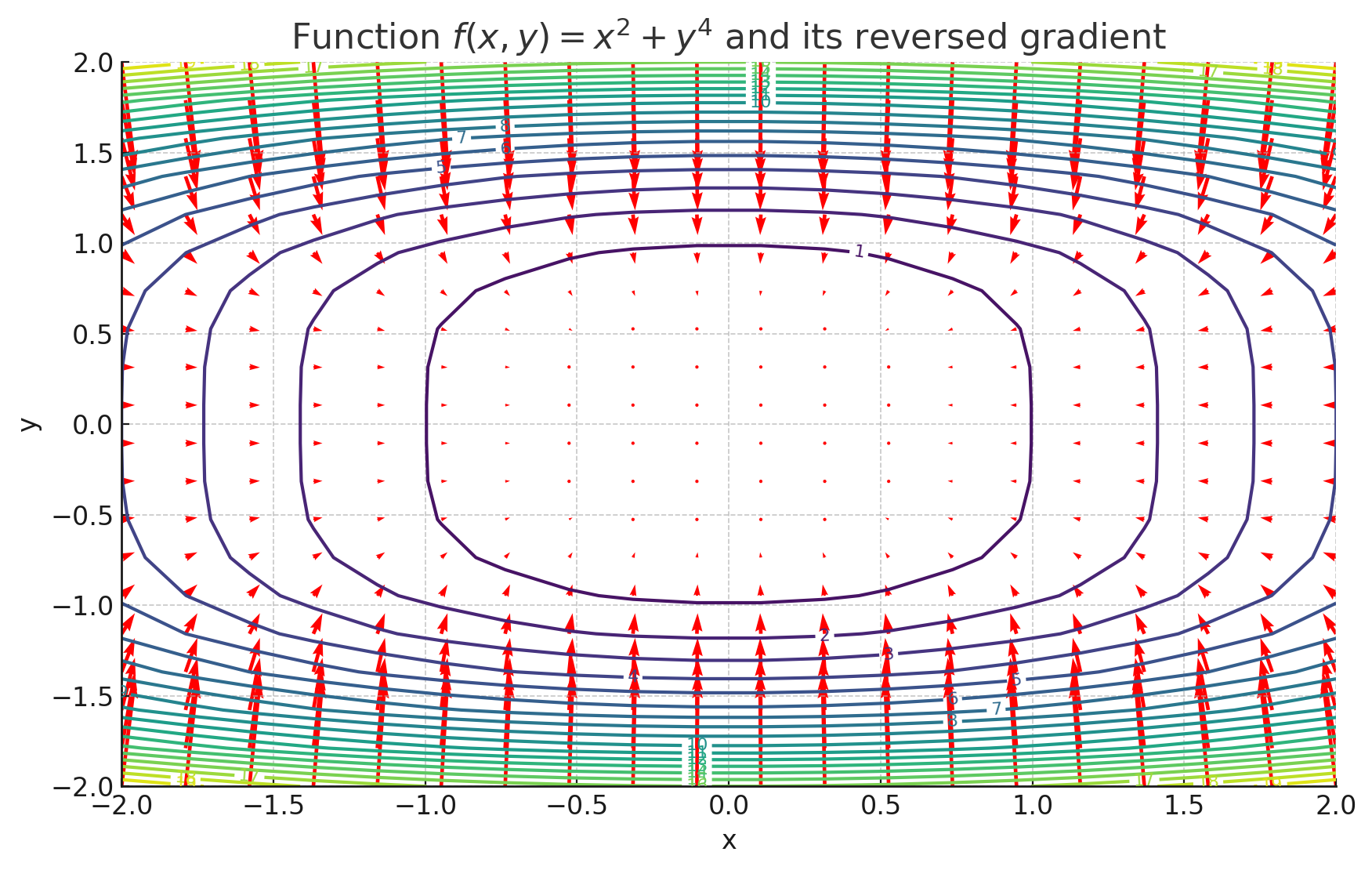

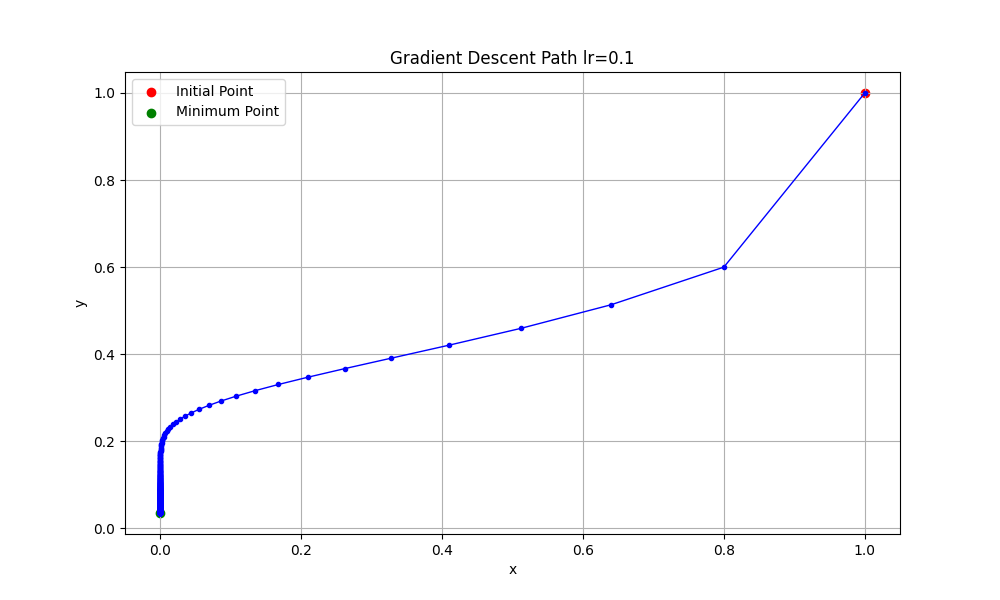

勾配法について!関数の最小値をpythonで求める

勾配法の手順 勾配法を用いて、関数の最小値を見つけるための手順を示します。 勾配法を用いて最小値を求める 勾配の計算 関数 \( f(x, y) = x^2 + y^4 \) の最小値を勾配法で求める …

-

deepsetのbert-large-uncased-whole-word-masking-squad2の使い方!Question Answering

BERTとは BERT(Bidirectional Encoder Representations from Transformers)はencoderのみの言語モデルです。bert-large-un …

-

bert-base-casedの使い方!Case Sensitiveを確認する!

BERTとは BERT(Bidirectional Encoder Representations from Transformers)はencoderのみのモデルです。bert-base-cased …

-

bert-base-uncasedの使い方!マスクされた単語を推測する!

BERTとは BERT(Bidirectional Encoder Representations from Transformers)はencoderのみのモデルです。bert-base-uncas …

-

ソフトマックス(softmax)関数について解説!具体的に計算する!

ソフトマックス関数の概要 ソフトマックス関数(Softmax function)は、機械学習において、特に分類問題で広く使用される関数です。この関数は、入力ベクトルを受け取り、各要素を0から1の範囲の …

-

【Transformers】SwallowをHugging Faceで使う方法

Swallowとは? 産業技術総合研究所(産総研)と東京工業大学の研究チームは、「Swallow」という日本語に特化した大規模言語モデルを2023年12月19日に公開しました。このモデルは、米Meta …

-

スパコン「富岳」で学習したFugaku LLMをHugging Faceからダウンロードして使う方法

Fugaku LLMとは? Fugaku-LLMは、日本のスーパーコンピュータ「富岳」を活用した大規模言語モデルです。このモデルは、特に日本語の自然言語処理において高い性能を発揮することが期待されてい …